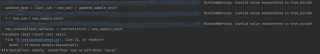

如何在深度学习中出现的keras库问题?(语言-python)

请问这个问题应该怎么解决,我看了一些其他的回答说将model=tf.keras.models.Sequential()替换成model=tf.contrib.keras.models.Sequential(),但是替换之后同样出现报错关于contirb库的。好问题!!抱歉我也不太懂,你问问chatGPT吧:https://new.quke123.com/ 或者其他Python群友:https://app.yinxiang.com/fx/13ce6bbd-f36f-4e92-be53-92dd381ed729

- 请看👉 :tf.keras学习总结(一):keras的Sequential模型编写方式

- 同时,你还可以查看手册:tf.keras.models.Sequential 中的内容

- 除此之外, 这篇博客: keras神经网络搭建六步法中的 tf.keras.models.Sequential() 部分也许能够解决你的问题, 你可以仔细阅读以下内容或跳转源博客中阅读:

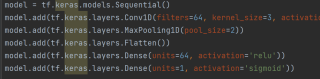

Sequential 函数是一个容器,描述了神经网络的网络结构,

在Sequential函数的输入参数中描述从输入层到输出层的网络结构。例如

model=tf.keras.Sequential(layers=[tf.keras.layers.Dense(3,activation="relu"), tf.keras.layers.Dense(3,activation="softmax")])常用的层有:

- 拉直层 tf.keras.layers.Flatten():拉直层可以变换张量的尺寸,把输入特征拉直为一维数组,是不含计算参数的层。

- 全连接层 tf.keras.layers.Dense(神经元个数,activation=”激活函数”, kernel_regularizer=”正则化方式”)。

- 卷积层 tf.keras.layers.Conv2D(filter=卷积核个数,kernel_size = 卷积核尺寸, strides = 卷积步长, padding = “valid” or “same”)

- LSTM 层 tf.keras.layers.LSTM()。

其中activation(字符串给出)可选 relu、softmax、sigmoid、tanh等

kernel_regularizer 可选 tf.keras.regularizers.l1()、 tf.keras.regularizers.l2()