训练一个基于densenet的网络的时候出现了下面的情况,请问是什么原因导致的呢lr=0.01 batchsize = 8

训练一个基于densenet的网络的时候出现了下面的情况,请问是什么原因导致的呢

lr=0.01 batchsize = 8

这情况哪里不正常吗?.. 波动大? 就是这样的,训练轮数多了才能相对稳定,收敛.

还是说你有其他疑问...

【相关推荐】

- 这篇博客: DenseNet占用内存过高(batch-size只能设置为1)解决方案中的 二、训练自己的数据集 部分也许能够解决你的问题, 你可以仔细阅读以下内容或跳转源博客中阅读:

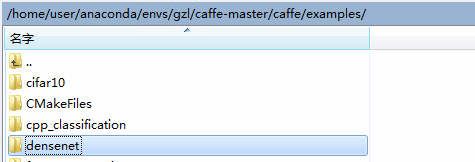

1 在caffe/examples中新建一个文件夹 densenet

https://github.com/Tongcheng/DN_CaffeScript

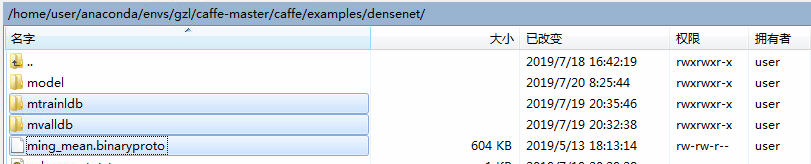

2 将自己数据集对应的trainldb和valldb以及均值文件放进去

3 下载 solver.prototxt文件 和 train_test_densenet.prototxt文件

4 按需修改solver.prototxt文件

5 按需修改 train_test_densenet.prototxt文件,主要修改均值文件和数据集文件路径以及batch-size大小

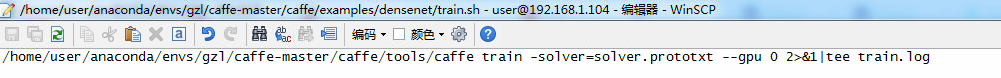

6 编写train.sh文件

7 开始训练

运行sh train.sh指令。说明:同样的显卡,这种方法的TRAIN的batch-size设置成了8,TEST的batch-size设置成了2。

作者:GL3_24

来源:CSDN

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

如果你已经解决了该问题, 非常希望你能够分享一下解决方案, 写成博客, 将相关链接放在评论区, 以帮助更多的人 ^-^