如何判断特征提取好坏?

如果两个模型进行同一数据集的分类处理最后准确度差不多,是不是可以说他们特征提取程度差不多

具体例如:我用resnet50对花分类训练50次,最后93.然后我用mobilnet也是对花分类训练50次,最后91.可以说在特征提取方面他们差不多。代码都是官方代码。

首先,resnet50和mobilenet网络好像并不是一样的,另外,由于卷积核参数的随机性,每做一次卷积其实都会浪费掉一些信息,即使有shortcut。所以这里用最终的acc结果去反应最前面的特征提取,是没有依据的,这也是机器学习的一个基础问题。

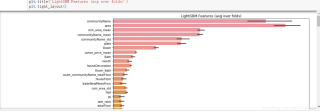

在机器学习里,图像的提取方法有SIFT / HOG / ORB / HAAR等等方法,或者从广义上还能使用树模型,通过树的信息增益获取数据,比如两个模型预测的acc差不多,其实它们都是根据特征的贡献度来进行排序拟合,比如说我有一篇博客为:https://blog.csdn.net/submarineas/article/details/103863310,其中我在最后用lightgbm可以获取到当前模型对于特征的贡献度排序图:

但是如果换一种模型,比如说xgboost,那数增益选择的特征可能就不一样了,但结果最终还是相同的,因为我可以过拟合训练,并且数据集的分布一致等都会导致相同情况。

最后总结就是,特征提取只是整个过程中的一个步骤而已,如果细分,还可以细分为特征提取和特征选择,特征提取是从原始特征集中提取/导出信息以创建新的特征子空间。其主要思想是压缩数据,并保持大部分相关信息。而特征选择是从原始特征中选择一个特征子集,以降低模型复杂度,提高模型的计算效率,减少无关特征由于噪声引入的泛化误差。两者的区别在于,特征选择是在算法的情况下保留了原始特征,但特征提取算法将数据转换为新的特征空间。

首先深度学习的特征提取是卷积自动提取的,影响准确率不只是特征提取,还有模型结构,超参,参数,优化器,损失函数等等,这个只能说mobilenet在较小参数量达到和resnet相近的效果而已