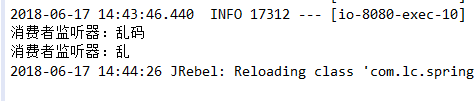

windows系统 在java中发送消息到kafka,在控制台显示中文,在kafka中文乱码

控制台可能是gbk编码等。最好把字符统一用utf8编码处理一下再送到kafka,读取的时候对应解码

utf-8设置没有啊

使用Intelli idea调试kafka low consumer时,由于broker存储的message有中文,

idea中console端是可以正确显示的

然后mvn package打包到服务器上执行,结果中文乱码。

然后在kafka consumer代码中byte转为string时,使用了各种编码

String mes = new String(bytes,"UTF-8");

String mes = new String(bytes,"GBK");

String mes = new String(bytes,"iso8859-1");

问题还是没有解决。然后一直google,摆渡,看到有人说到jvm的默认编码会影响程序的编码,于是在程序中把

Charset.defaultCharset()打印出来,结果,在idea中显示的是UTF-8,在服务器上执行时就变成了US-ASCII。

我整个工程都是以UTF-8编码的,难怪在服务器上中文会乱码了。问题找到了,然后又经过一番折腾,终于解决了问题

在/etc/profile添加HADOOP_OPT="-Dfile encoding=UTF-8",保存退出 source /etc/profile,重新执行

hadoop jar kafkaHdfs-1.0-SNAPSHOT-jar-with-dependencies.jar org.conan.kafka.AllTopicsConsumer ./hdfs.properties

输出和输入端,在转换流加入编码库,应该就可以解决你的问题了

这么久了,第一次遇到乱码的,Linux默认编码格式就是UTF-8,默认配置的情况下是不会出现的,除非工具输入的时候转换已经是乱码了,消费的时候自然就是乱码,你可以换个工具试试。