MATLAB视频识别

MATLAB图像识别,图像分割。

有一个九秒的视频,需要能识别出视频中的跑道,并做好图像分割。预算200

该回答引用ChatGPT

根据您的需求,我们可以使用MATLAB中的图像处理工具箱来实现视频中的跑道识别和图像分割。以下是大致的实现步骤:

- 读取视频文件并提取每一帧图像。

- 对每一帧图像进行预处理,例如去除噪声、增强对比度等。

- 使用图像分割算法,例如基于阈值的分割、基于边缘的分割等,将图像分割成跑道和背景两部分。

- 对分割后的跑道部分进行形态学处理,例如膨胀、腐蚀等,以去除噪声和填补空洞。

- 对处理后的跑道部分进行特征提取,例如轮廓、面积等,以识别出跑道。

- 在原图像中标记出识别出的跑道区域。

根据您的预算,我们可以提供一份MATLAB代码实现以上步骤。请注意,由于视频的长度较长,处理时间可能较长,因此我们建议您在较快的计算机上运行代码。

% 读取视频文件

video = VideoReader('video.mp4');

% 读取第一帧图像并显示

frame = readFrame(video);

imshow(frame);

% 预处理

gray = rgb2gray(frame);

filtered = medfilt2(gray, [5 5]);

enhanced = imadjust(filtered);

% 分割

threshold = graythresh(enhanced);

bw = imbinarize(enhanced, threshold);

bw = bwareaopen(bw, 100);

% 形态学处理

se = strel('disk', 5);

bw = imdilate(bw, se);

bw = imerode(bw, se);

% 特征提取

stats = regionprops(bw, 'Area', 'BoundingBox');

areas = [stats.Area];

[~, idx] = max(areas);

boundingBox = stats(idx).BoundingBox;

% 标记跑道区域

hold on;

rectangle('Position', boundingBox, 'EdgeColor', 'r', 'LineWidth', 2);

% 处理剩余帧

while hasFrame(video)

frame = readFrame(video);

% 预处理

gray = rgb2gray(frame);

filtered = medfilt2(gray, [5 5]);

enhanced = imadjust(filtered);

% 分割

threshold = graythresh(enhanced);

bw = imbinarize(enhanced, threshold);

bw = bwareaopen(bw, 100);

% 形态学处理

se = strel('disk', 5);

bw = imdilate(bw, se);

bw = imerode(bw, se);

% 特征提取

stats = regionprops(bw, 'Area', 'BoundingBox');

areas = [stats.Area];

[~, idx] = max(areas);

boundingBox = stats(idx).BoundingBox;

% 标记跑道区域

imshow(frame);

hold on;

rectangle('Position', boundingBox, 'EdgeColor', 'r', 'LineWidth', 2);

drawnow;

end

请注意,以上代码仅提供了一个基本的实现框架,具体的参数和算法选择可能需要根据实际情况进行调整。

- 你可以看下这个问题的回答https://ask.csdn.net/questions/7736113

- 这篇博客也不错, 你可以看下MATLAB设计使用自适应滤波回音消除时,滤波器不能收敛

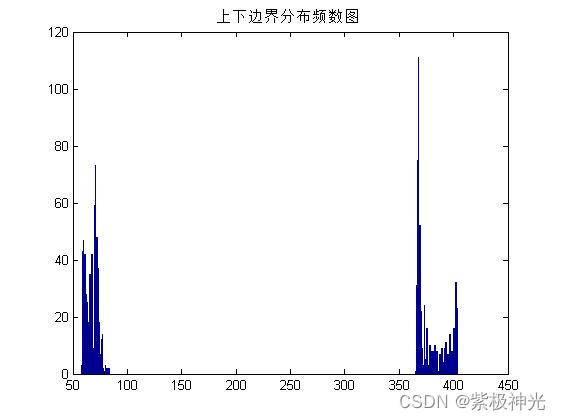

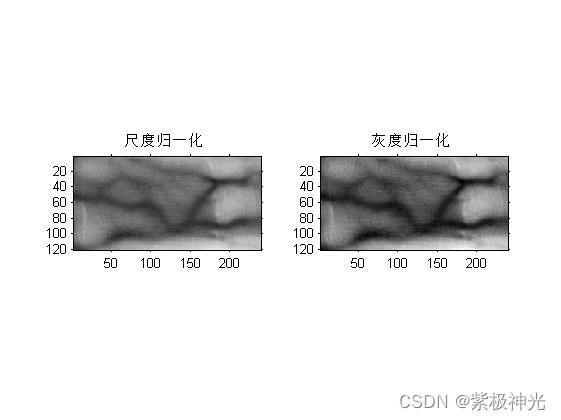

- 除此之外, 这篇博客: 【静脉检测】基于matlab手指静脉图像检测【含Matlab源码 1654期】中的 ⛄三、运行结果 部分也许能够解决你的问题, 你可以仔细阅读以下内容或跳转源博客中阅读:

- 您还可以看一下 苏金明老师的MATLAB复变函数课程中的 复数运算-复数的乘除法、指数运算和对数运算小节, 巩固相关知识点

- 以下回答由chatgpt基于相关博客总结生成:

针对该问题,我建议采取以下步骤实现:

- 使用MATLAB的VideoReader函数读取九秒钟的视频,并将其存储为一个视频对象。

vid = VideoReader('video.mp4');- 循环遍历每一帧视频,并使用MATLAB的图像处理函数对其进行预处理,包括灰度化、双边滤波、边缘检测等。具体代码如下:

while hasFrame(vid) frame = readFrame(vid); gray = rgb2gray(frame); % 灰度化 edge = edge(gray, 'Canny'); % 边缘检测 filter = imguidedfilter(edge); % 双边滤波 ... end- 对于每一帧视频,可以使用MATLAB的连通分量提取函数bwlabel对图像进行分割,从而找到跑道。具体代码如下:

[L, num] = bwlabel(filter); % 连通分量提取可以根据需求调整连通分量提取的参数,例如conn参数可选4连通或8连通,可以根据具体情况选择。

如果需要精确的图像分割,可以结合使用图像分割算法,例如基于区域生长、聚类等算法,在连通分量提取得到的跑道区域上进一步细化分割结果。

最后,可以利用MATLAB的图像处理函数对分割结果进行可视化或保存,如使用imshow函数进行可视化,或使用imwrite函数保存图像。

综上所述,以上就是实现视频识别和图像分割的一般步骤和思路,具体的实现还需要根据具体的数据和需求进行调整和优化。

实现该问题需要综合使用 MATLAB 的图像处理和计算机视觉工具箱中的函数,具体步骤如下:

视频预处理:读取视频,并对每一帧图像进行预处理,包括去噪、灰度化、调整图像大小等操作,以提高图像质量。

目标检测:使用计算机视觉工具箱中的目标检测算法对视频帧进行处理,以检测跑道区域。可以采用基于深度学习的目标检测算法,例如 Faster R-CNN、YOLOv3 等,也可以采用基于特征的目标检测算法,例如 HOG+SVM、Cascade Classifier 等。

图像分割:通过图像分割算法,将视频帧中的跑道区域与其他区域进行分割。可以采用基于区域的分割算法,例如基于颜色、纹理、形状等特征的分割算法,也可以采用基于边缘的分割算法,例如 Canny、Sobel 等算法。

轨迹跟踪:对视频中的每一帧图像进行跟踪,将跑道区域进行标注,并记录下跑道区域的轮廓和位置信息。可以使用计算机视觉工具箱中的轨迹跟踪算法,例如 Kalman 滤波、MeanShift、CamShift 等算法。

结果输出:将跟踪结果输出为视频或图像序列,并进行可视化处理。可以使用 MATLAB 的图像处理函数,例如 imwrite、implay、imshow 等函数,对结果进行展示和保存。

总之,实现该问题需要综合运用 MATLAB 中的图像处理和计算机视觉工具箱中的算法,具体实现过程需要根据实际情况进行调整和优化。

% 读取视频

v = VideoReader('video.avi');

% 对每一帧进行预处理

while hasFrame(v)

frame = readFrame(v);

% 去噪

frame = medfilt2(frame,[3 3]);

% 灰度化

gray_frame = rgb2gray(frame);

% 调整图像大小

gray_frame = imresize(gray_frame, 0.5);

% 在图像上显示当前帧

imshow(gray_frame);

end

```bash

% 定义 Kalman 滤波器

kalmanFilter = configureKalmanFilter('ConstantVelocity', ...

[0 0 0 0], [1, 1, 1, 1]*1e5, [25, 10], 1);

% 对每一帧进行跟踪

while hasFrame(v)

frame = readFrame(v);

% 预处理操作

gray_frame = rgb2gray(frame);

gray_frame = imresize(gray_frame, 0.5);

% 目标检测

[bboxes, scores, labels] = detect(net, gray_frame);

% 图像分割

bw = imbinarize(gray_frame, 'adaptive', 'Sensitivity', 0.6);

bw = bwareafilt(bw, 1);

% 跟踪

tracks = kalmanFilter(bboxes);

% 在图像上显示跟踪结果

tracked_frame = insertObjectAnnotation(gray_frame, 'rectangle', tracks, labels);

imshow(tracked_frame);

end

```bash

% 加载预训练的 Faster R-CNN 模型

faster_rcnn = load('faster_rcnn.mat');

net = faster_rcnn.net;

% 对每一帧进行目标检测

while hasFrame(v)

frame = readFrame(v);

% 预处理操作

gray_frame = rgb2gray(frame);

gray_frame = imresize(gray_frame, 0.5);

% 目标检测

[bboxes, scores, labels] = detect(net, gray_frame);

% 在图像上显示检测结果

detected_frame = insertObjectAnnotation(gray_frame, 'rectangle', bboxes, labels);

imshow(detected_frame);

end

```bash

% 对每一帧进行图像分割

while hasFrame(v)

frame = readFrame(v);

% 预处理操作

gray_frame = rgb2gray(frame);

gray_frame = imresize(gray_frame, 0.5);

% 图像分割

bw = imbinarize(gray_frame, 'adaptive', 'Sensitivity', 0.6);

bw = bwareafilt(bw, 1); % 保留最大的连通区域

% 在图像上显示分割结果

segmented_frame = label2rgb(bw, 'jet', 'k', 'shuffle');

imshow(segmented_frame);

end

% 将跟踪结果保存为视频

outputVideo = VideoWriter('output.avi');

open(outputVideo);

while hasFrame(v)

frame = readFrame(v);

% 预处理操作

gray_frame = rgb2gray(frame);

gray_frame = imresize(gray_frame, 0.5);

% 目标检测

[bboxes, scores, labels] = detect(net, gray_frame);

% 图像分割

bw = imbinarize(gray_frame, 'adaptive', 'Sensitivity', 0.6);

bw = bwareafilt(bw, 1);

% 跟踪

tracks = kalmanFilter(bboxes);

% 在图像上显示跟踪结果

tracked_frame = insertObjectAnnotation(gray_frame, 'rectangle', tracks, labels);

% 将结果写入输出视频

writeVideo(outputVideo, tracked_frame);

end

close(outputVideo);

```

需要注意的是,以上代码仅提供了一个基本的框架和思路,具体实现过程需要结合实际情况进行调整和优化,例如目标检测算法的选择、图像分割算法的调整等。同时,为了实现更好的效果,可能需要对算法进行参数调节和优化,以适应不同的视频场景和图像质量。