神经网络训练中数据丢失

神经网络训练中数据丢失

训练集和测试集大小如下:

print(x_train.shape)

print(y_train.shape)

print(x_test.shape)

print(y_test.shape)

(12724, 64, 64, 3)

(12724, 5)

(3182, 64, 64, 3)

(3182, 5)

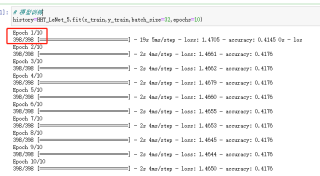

但在神经网络训练中,只使用到了部分数据

请问各位这个情况是怎么回事呢?

全部的数据都利用了的,你把batchsize设为1,就会看到12724。因为你的batchsize是32,这里的398是指迭代次数。batch size为32时,迭代398次可以训练一个epoch(把所有的数据训练一次)。32*398=12736,大于12724,说明你这里的最后一个batch不足32个数据。