pytorch训练时怎么提高显卡的利用率?

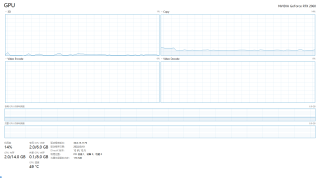

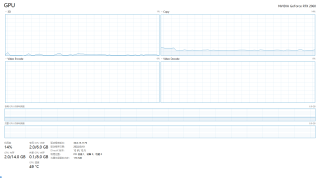

如图,我的2060才利用了百分之十几,跑个简单的模型都慢死。想问一下怎么提高利用率?

work number设置到cpu最大核心数,batch size 搞大点,你的显存才用了2G,还有那么多呢,不过显卡利用率低很正常,又不是挖矿,显卡很多时候要等硬盘或者内存读取信息呢。

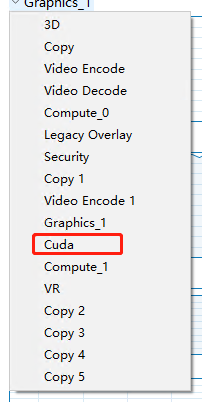

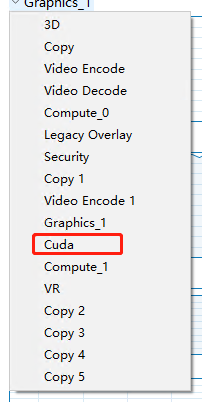

你把这里换成cuda就知道了,一阵高一阵低,就是显卡计算快,数据传输慢,导致显卡计算完了要等其他数据才能继续计算

调大batch size

work number设置到cpu最大核心数,batch size 搞大点,你的显存才用了2G,还有那么多呢,不过显卡利用率低很正常,又不是挖矿,显卡很多时候要等硬盘或者内存读取信息呢。

你把这里换成cuda就知道了,一阵高一阵低,就是显卡计算快,数据传输慢,导致显卡计算完了要等其他数据才能继续计算

调大batch size