重新编译spark-redshift遇到的问题

- 由于使用的s3的region是cn-north-1,需要对databrick提供的spark-redshift包进行重新编译

- 由于源码是sbt进行代码管理的,了解较少,遇到一些问题难以解决

- 从databricks/spark-redshift: Redshift data source for Apache Spark (github.com)下载源码后进行编译,发现有许多依赖问题无法解决

- 问题报的

有加相关仓库配置但仍不生效

您好,关于重新编译spark-redshift遇到的问题,根据您提供的情况,建议您尝试以下解决方案:

确认您是否已经将sbt的版本升级为1.3以上,因为根据错误提示,可能是由于sbt版本太低导致的依赖问题。

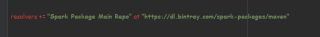

设置Spark包仓库,根据您提供的参考链接,可以在sbt配置文件中添加以下内容:

```

resolvers += "Spark Packages Repo" at "https://d/