为什么我自己训练的CycleGAN网络效果不好

做apple2orange只转换了颜色,纹理一点没变。

代码抄github上junyanz/pytorch-CycleGAN-and-pix2pix的,训练过程除了没用ImagePool来训练判别器,其他部分基本一样,网络的话生成器上下采样和判别器都无脑做了残差,然后网络大小比github上的原版小很多。

最后就是想问:这种情况是网络的问题?还是损失函数各个比重的问题?还是训练时间的问题?正常的训练过程中,随着训练次数的增加,生成的图像是怎么变化的,是开始清晰的时候就有纹理了吗?

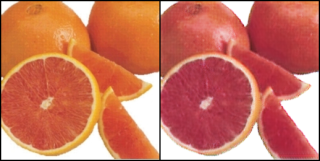

转换效果像下面这样,感觉就是色调调了一下😂。

同样是这个问题,请问楼主现在找到解决办法了吗?