用spark提供的java API写的程序怎么远程提交到集群上运行。

小弟最近在做一个机器学习平台,想通过前台选择数据源、算法、参数之类的东西,由后台程序提交到spark集群上调用sparkML库来跑出结果,然后把结果返回之后在前台渲染出效果。实验室之前有搭spark集群,这两天看了一下java提交任务上去spark集群的东西,似乎都是要先把东西打jar包,再传服务器通过spark-submit,这样跟需求就不符了,恳求各位使用java调用过spark的大侠答疑解惑。委实是之前没用过这方面的使用经验。之前有找过一些代码如下。

public class TestUtil {

public static void main(String[] args){

System.setProperty("user.name", "root");

SparkConf conf = new SparkConf().setAppName("Spark Java API 学习")

.setMaster("spark://211.87.227.79:7077");

JavaSparkContext sc = new JavaSparkContext(conf);

JavaRDD<String> users = sc.textFile("hdfs://211.87.227.79:8020/input/wordcount.txt");

System.out.println(users.first());

}

}

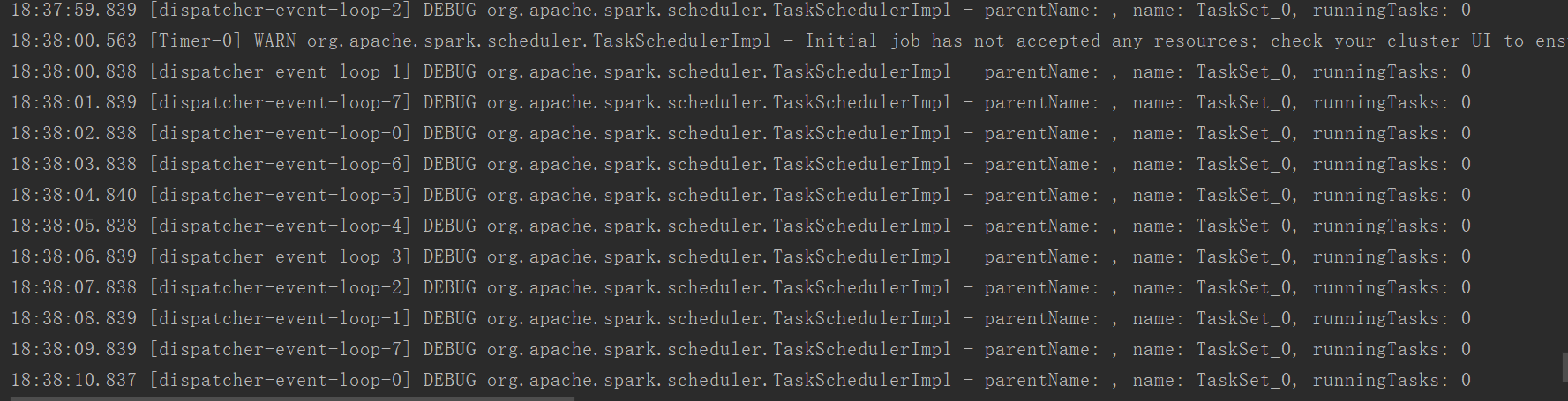

看了spark的UI这个任务确实也提交上去了,但是idea的控制台一直重复地报这一段

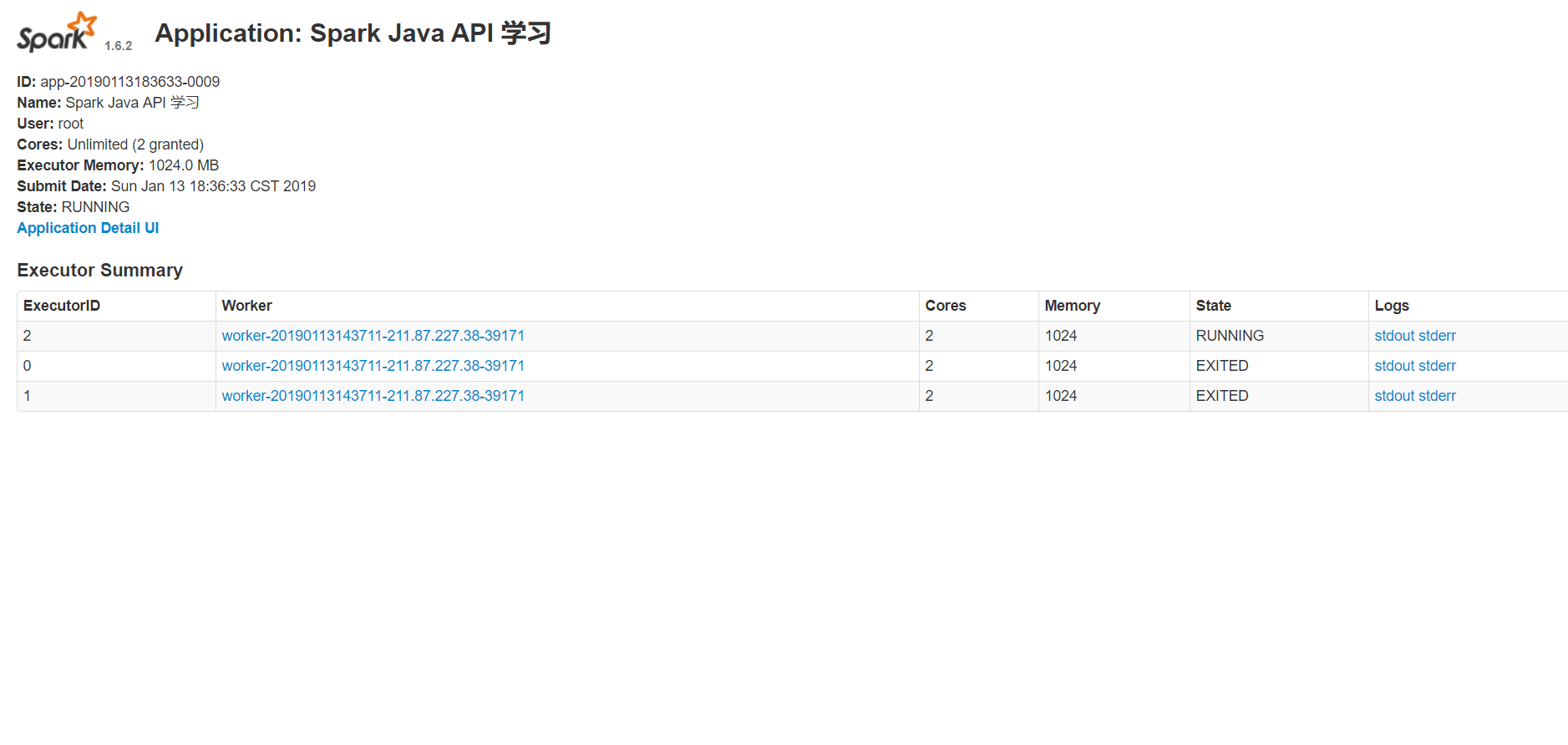

sparkUI如图。

CSDN没币了没法悬赏。要是有大侠可以解决,可以有偿,留联系方式就行。