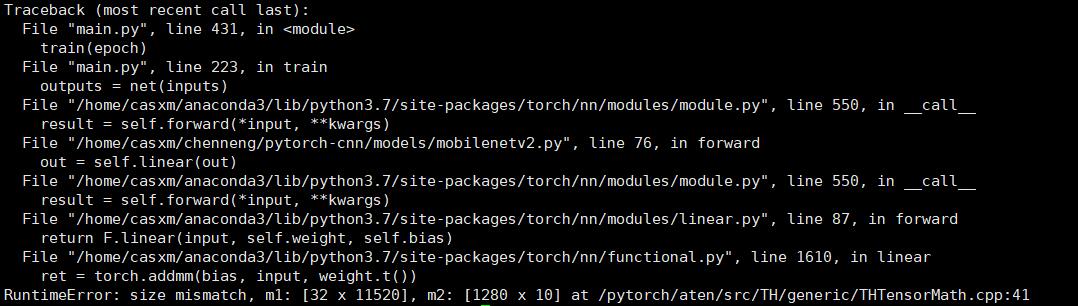

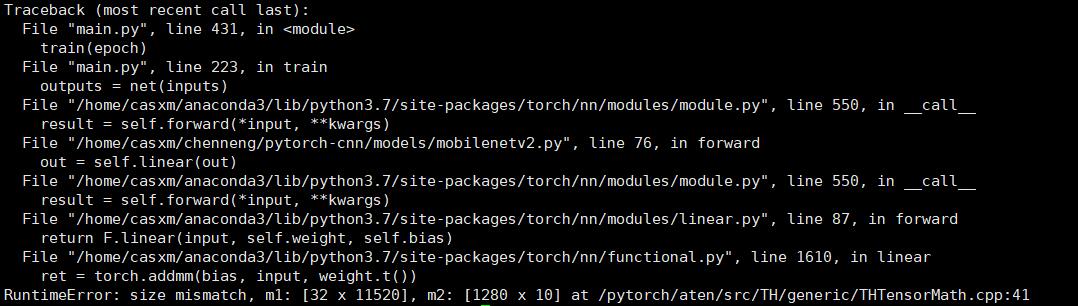

Pytorch 修改batchsize导致 size mismatch

用mobilenetv2训练cifar10, 设置batchsize=128时显示out of memory,把batchsize改成32又报错sizemismatch,如图

修改batch size,你应该重新训练模型。

我也有同样问题,请问解决了吗

用mobilenetv2训练cifar10, 设置batchsize=128时显示out of memory,把batchsize改成32又报错sizemismatch,如图

修改batch size,你应该重新训练模型。

我也有同样问题,请问解决了吗